哎,我跟你们说,上个周末我差点没把自己给气笑了。

事情是这样的,我不是一直馋那种街角的老字号烧腊店吗?那天特意绕远路找过去,结果你猜怎么着?店门口挂了个招牌,上面用艺术字体龙飞凤舞地写着几个大字,我眯着眼睛看了半天,愣是没认出来那是“今日特供”还是“本店休息”。旁边还贴了张小告示,字儿比蚂蚁还小,我掏出手机拍了照,恨不得把照片放大到马赛克级别,还是看不清。

当时我就站在风口里,像个二傻子一样举着手机,心里把那招牌的字体设计师祖宗十八代都问候了一遍。我那老伙计,外号叫“狗蛋”的,要是看见我这熊样,肯定得操着他那口河南腔损我:“恁这眼是出气儿使哩?真是‘钛合金狗眼’瞎了半拉!”

这事儿要搁以前,也就只能自认倒霉。但巧就巧在,我前两天刚好看了一堆关于视觉AI代理的新玩意儿。这玩意儿,简直就是为了治我这种“眼神不好使”的毛病来的。

咱们以前用那些识图功能,怎么说呢,就是有点“有眼无珠”。你把图片扔给它,它就像个刚进大观园的刘姥姥,看着热闹,看不出门道。你问它那招牌上写的啥,它瞅一眼,可能给你蹦出个“食物”或者“文字”,然后就没下文了。你得自个儿放大、自个儿琢磨,它顶多算个放大镜,还是个不太聪明的放大镜。

但现在不一样了。我瞅着谷歌新升级的那个Gemini 3 Flash,里头加的“Agentic Vision”功能,那可真是鸟枪换炮 -1。这玩意儿不再是傻乎乎地看一眼就完事儿,它学会了自己“琢磨”。你给它一张模糊的电路图,或者像我遇到的这种看不清的小字,它会自个儿先制定个计划:“嗯,这地儿看不清,我得放大看看。那边有个零件,我得给它标出来。”然后它真的会像个人一样,对着图片又剪又裁,来回端详,最后才给你一个准信儿 -1。

这感觉就像啥呢?就像你身边突然跟了个老侦探,你还在那儿瞪眼抓瞎呢,人家已经拿着放大镜趴地上找了一圈线索,回头跟你分析案情了。这准确率,据说在一些刁钻的任务上一下子提了5%到10% -1。你别小看这点提升,关键时刻,这就决定了你是在风中凌乱,还是能推开那扇门吃上那口热乎饭。

而且你知道吗,这波视觉AI代理的进化,不光是让手机里的App变聪明了,它已经开始“长”在我们脸上了。前阵子那个世界移动通信大会(MWC),我有个在深圳华强北混的哥们儿,天天跟我念叨雷鸟出的那个新眼镜,跟德国电信鼓捣出来的 -2。

他跟我形容那场景,说得我那个心痒痒。他说你戴上那眼镜,往那儿一坐,眼睛扫到桌上的菜单,要是外国字儿,那眼镜上直接就给你叠加上翻译了,甚至还能根据你以前爱吃的口味,给你推荐“这个招牌菜贼辣,您慎点”或者“这个甜口,适合您带闺女吃” -4。这哪还是眼镜啊,这简直就是个贴在脸上的“万事通”啊!以前咱们是“人找服务”,得掏出手机,打开App,点开相机,一顿操作。现在好了,成了“服务找人”,你眼神往哪儿飘,服务就跟到哪儿 -2。我那哥们儿最后来了句总结,特精辟:“以后泡妞都不用找话题了,眼神一扫,眼镜直接告诉你她穿的鞋是啥牌子,最近哪家店打折,你直接上去就聊,省了查户口那步了。”

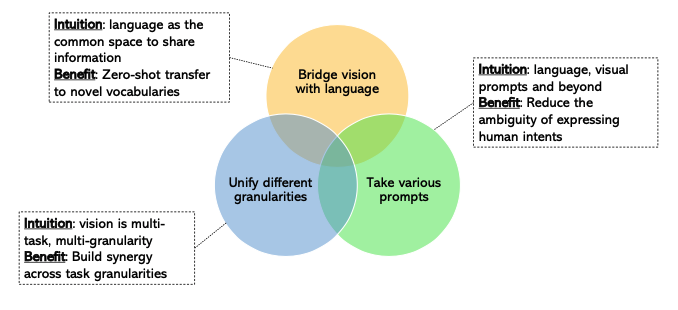

当然,这东西听着神,背后其实就是那个“代理”的思维在作祟。它不再是等你下命令,而是通过“看”去理解你的“意图”。以前咱们教AI看东西,是给它看一万张猫的照片,告诉它“这是猫”。现在是让它看着你,看着你眼前的场景,自己去想:“这货盯着这个看半天了,是不是想吃?是不是想买?是不是迷路了?” -9

根据那些市场研究的报告,这玩意儿到2032年市场规模得奔着一亿多美金去 -3。为啥这么火?还不是因为它解决了咱们这些懒人的核心痛点——不想动手,只想动眼,甚至眼都不想多动,最好脑子一想事儿就成了。现在那些大厂在搞的“世界模型”,其实就是想教会AI理解这个物理世界的运行规律 -5。到时候,它看你倒水,知道水满了会停;看你走路,知道前面有坑得提醒。那才叫真的“眼力见儿”。

所以我说,这回视觉AI代理的升级,是真真切切治好了我这种眼神不好、脑子还懒的毛病。以前出门靠朋友,以后出门可能真得靠这副“钛合金狗眼”加上AI大脑了。虽然现在有时候还是会出点小bug,比如把路边的大树识别成巨大的西兰花,但这种带着点“人味儿”的错误,反倒显得它们没那么机器了,你们说是不是这个理儿?

下面咱们也别光我一个人在这儿嘚啵嘚,我估计大伙儿心里肯定有不少问号。我特意挑了几个后台网友可能会问的问题,咱们敞开了聊聊。

网友“科技宅小张”问:

这东西听起来是牛逼,但咱普通人啥时候能用上啊?不会是又像以前那些概念车一样,只活在PPT里吧?我现在手机里那些App能用上吗?

答:

哎,小张这话问到点子上了,最怕就是“只听楼梯响,不见人下来”。你放心,这次还真不是PPT造车。我跟你盘道盘道。

像谷歌那个Gemini 3 Flash的“Agentic Vision”功能,人家已经没藏着掖着了,直接在Gemini AI Studio和Vertex AI这些平台上线了 -1。虽然现阶段主要是给开发者折腾的,但这就是个强烈的信号弹啊!说明这技术已经成熟到可以拿出去见人了。那些开发者用这个功能,就能做出更牛逼的App。比如以后咱们用的扫描软件,扫描一份模糊的PDF,它不再是简单转成文字,而是能理解图表和排版,直接给你生成一份整理好的思维导图。

你再看看CES(国际消费类电子产品展览会)那些风向标,大厂们已经把“AI代理”定位成下一代设备的核心了 -9。现在的AI PC和AI手机,芯片里都塞进了专门的神经网络处理单元,就是为了跑这些玩意儿。我掐指一算,最多再等个一年半载,咱们手机里的系统级AI,比如小爱同学、小艺、Bixby这些,全面升级具备这种深度视觉推理能力,那就是一个系统升级的事儿。说不定到了明年这会儿,咱们再用手机拍路牌,相册直接就弹个弹窗:“您是否在寻找这家店的营业时间?已为您高亮显示。”所以别急,这趟车已经开到站台边了,马上就要检票上车了。

网友“广州荔湾的芳姐”问:

我有老花,平时看药品说明书那叫一个痛苦,字比芝麻还小。这玩意儿要是戴眼镜就能解决,我肯定买。但我怕老人家学不会,操作复杂吗?万一它看错了咋整,这药可不敢乱吃啊!

答:

芳姐,您这问题提得太实在了,也正是我最想聊的“”。

关于操作,我跟您打包票,未来的趋势就是“零操作”。您看那个雷鸟和德国电信做的眼镜,最牛的地方就在于“服务懂人” -2。您不需要去按任何按钮,也不需要喊什么“嘿,Siri”。您就正常看东西,当您的视线在药品说明书上停留超过一定时间,或者您皱眉头的时候,眼镜里的AI就会主动问您:“需要帮您放大字体吗?或者我可以为您朗读说明书。”这就是视觉AI代理的魅力——它通过“看”来触发服务。所以根本不用担心学不会,它就像您的眼睛一样,您往哪儿看,它就在哪儿帮忙,比亲儿子还贴心。

至于准确率,您担心的太对了!吃药是大事,AI要是看错了“一次一片”看成“一次七片”,那得出大事。这就引出了另一个新技术,叫“代理视觉”的循环分析机制 -1。它不再是看一遍就下结论,而是会像医生看片子一样,反复确认。比如它看到“一次1片”,它会先定位到“用法用量”区域,然后放大,再对比药品数据库里的标准格式,最后甚至会用代码在后台做个验证,确认那个数字是“1”不是“7”。像Adobe研究的那种VipAct框架,也是让不同的AI智能体分工合作,有负责识别文字的,有负责理解上下文的,大家商量着出结果 -7。所以它的准确率提升,不是靠猜,是靠这种严谨的“调查”流程。当然,作为辅助工具,咱们自己最后也得瞪一眼,这叫“人机双保险”,您说对吧?

网友“程序员老李”问:

别光吹牛逼,这玩意儿背后是咋工作的?我看网上说的那个什么“代码执行”是啥意思?AI看个图还得自己写代码?这不脱裤子放屁吗?

答:

哈哈,老李这嘴够损的,但你这一问,直接问到了技术核心,外行绝对看不出来的门道!

乍一听,AI看个图还得自己写代码,好像是挺折腾的。但你听我给你打个比方你就明白了。以前的AI识图,靠的是“直觉”,神经网络刷一下,根据像素分布猜个大概。这就好比让一个米其林大厨光看菜谱封面猜味道,他能猜个大概齐,但说不出个一二三。

现在的“Agentic Vision”呢?它引入了“思考、执行、观察”的循环 -1。当它接到一个复杂任务,比如“把这张模糊照片里的车牌号找出来”,它会先“思考”:这图片太糊了,直接认认不出来,得先做个图像增强。但怎么增强呢?AI模型本身不擅长精确计算像素值。这时候,它就进入“执行”阶段:它自己动手写一段Python代码,调用OpenCV这种图像处理库,对图片进行去噪、锐化、调整对比度,甚至把车牌区域单独剪裁出来放大。

代码跑完了,它再“观察”处理后的结果,看这次看得清不清晰。如果还不行,它再换个算法,再写一段代码,直到得到满意的答案 -1。

所以,这不是脱裤子放屁,这是“工欲善其事,必先利其器”。AI用自己的“大脑”(语言模型)指挥“手”(代码执行)去操作工具,解决了它自身不擅长精确计算的短板。这就像是给了AI一个工具箱和一本说明书,让它从一个“猜测者”变成了一个“调查员”。这背后的架构,就像Adobe那个VipAct框架,有 orchestrator agent( orchestrator智能体)专门负责分派任务,让不同的专家智能体去干活 -7。这样一来,它能处理的视觉问题就不仅仅是认个花花草草了,而是能看懂复杂的图表、分析医疗影像,甚至在工厂里通过视觉判断机器有没有故障。这精度,那能是一个量级的吗?

上海羊羽卓进出口贸易有限公司

上海羊羽卓进出口贸易有限公司